La Inteligencia Artificial Generativa: Guía Exhaustiva y Retos del Contenido Creado por Máquinas

- La Inteligencia Artificial Generativa: Guía Exhaustiva y Retos del Contenido Creado por Máquinas

- Qué es la Inteligencia Artificial Generativa y por qué cambia el paradigma

- IA generativa vs IA tradicional: la diferencia matemática

- Modelos fundacionales: la infraestructura invisible

- Arquitecturas que hicieron posible la IA generativa

- Cómo funciona realmente la generación de contenido

- Qué puede crear la IA generativa

- Impacto económico y productividad global

- Riesgos estructurales del contenido creado por máquinas

- Cómo adoptar IA generativa sin destruir tu reputación

- La IA generativa como nueva infraestructura cognitiva

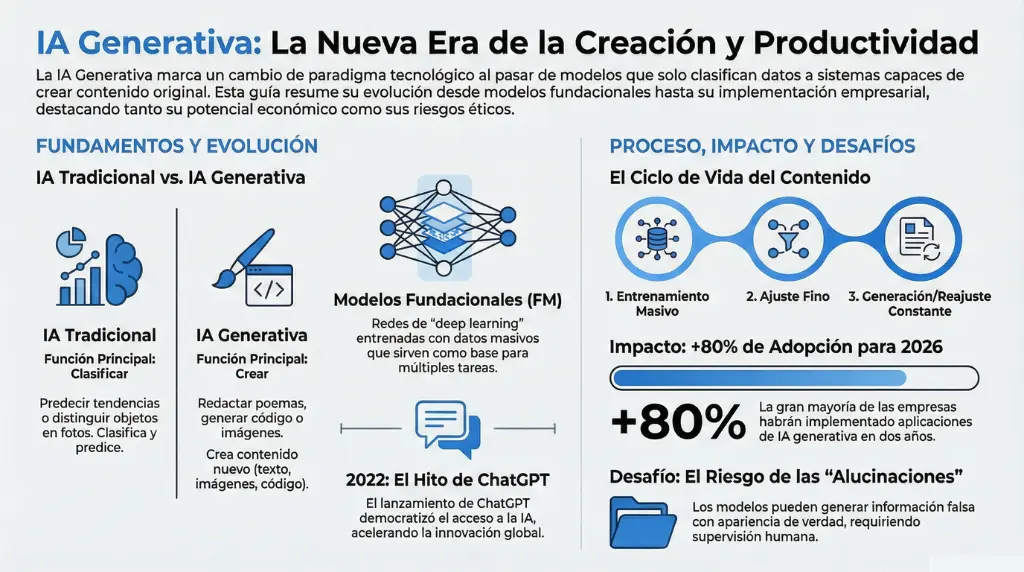

Cuando hablamos de Inteligencia Artificial Generativa, la conversación suele quedarse en la superficie: imágenes creadas por IA, textos automáticos, música sintética. Pero esa visión es reducida. Porque lo que realmente está ocurriendo no es solo generación de contenido. Es un cambio estructural en la forma en que producimos información.

Aquí está la hipótesis central que debes tener clara desde el inicio: la IA generativa no es una herramienta creativa más. Es la primera infraestructura cognitiva industrializada. Permite producir texto, imagen, audio y código a una velocidad y escala que ningún sistema previo había logrado.

No estamos ante una mejora incremental del software tradicional. Estamos ante modelos capaces de aprender patrones complejos del mundo digitalizado y reproducirlos con variaciones plausibles.

Antes de entrar en arquitecturas y modelos, necesitamos responder con precisión qué es realmente la Inteligencia Artificial Generativa y por qué cambia el paradigma frente a la IA tradicional.

Qué es la Inteligencia Artificial Generativa y por qué cambia el paradigma

La Inteligencia Artificial Generativa es una rama de la IA diseñada para crear contenido nuevo a partir de patrones aprendidos durante su entrenamiento.

A diferencia de sistemas predictivos clásicos —que clasifican, detectan o recomiendan— los modelos generativos producen secuencias originales: texto, imágenes, música, video o incluso código.

El cambio no es solo funcional. Es matemático.

Mientras la IA tradicional optimiza funciones para reconocer patrones existentes, la IA generativa modela distribuciones de probabilidad que le permiten muestrear nuevas instancias coherentes con los datos originales.

No copia. No recupera. Genera a partir de probabilidades.

Esa capacidad se apoya en arquitecturas profundas entrenadas sobre volúmenes masivos de datos. Y cuando esa escala alcanza cierto umbral, emergen comportamientos que antes parecían exclusivos del juicio humano.

Pero para comprender realmente la ruptura, necesitamos contrastarla con la IA tradicional desde una perspectiva estructural.

IA generativa vs IA tradicional: la diferencia matemática

Para entender la ruptura que introduce la Inteligencia Artificial Generativa, necesitas ir más allá del discurso mediático. La diferencia no es estética. Es matemática.

La IA tradicional, en su mayoría, ha sido discriminativa. Esto significa que aprende a clasificar o predecir etiquetas dadas ciertas entradas. Por ejemplo: detectar si una imagen contiene un objeto específico o predecir la probabilidad de que un cliente abandone un servicio.

Funciona optimizando una función que separa categorías.

La IA generativa, en cambio, modela la distribución completa de los datos. No aprende solo a decir “esto es A o B”. Aprende cómo se ve A internamente. Aprende cómo se estructura el lenguaje, cómo se organiza una imagen, cómo se compone una melodía.

No clasifica. Reconstruye probabilísticamente.

En términos simples:

- Un modelo tradicional responde: “¿Qué es esto?”

- Un modelo generativo responde: “Si esto existiera, ¿cómo se vería?”

La diferencia parece sutil. No lo es.

Modelar distribución implica estimar cómo se organizan los datos en su conjunto. Eso requiere mayor capacidad computacional, mayor volumen de datos y arquitecturas más complejas.

Cuando esa escala se logra, el sistema puede generar instancias nuevas que no estaban explícitamente en el entrenamiento, pero que son coherentes con los patrones aprendidos.

Eso es lo que hace posible que un modelo genere un texto original o una imagen inédita.

Pero esa capacidad no surgió de la nada. Está respaldada por una evolución de arquitecturas que hicieron viable esta generación.

Modelos fundacionales: la infraestructura invisible

Si la Inteligencia Artificial Generativa produce contenido nuevo, la pregunta inevitable es: ¿sobre qué se sostiene esa capacidad?

La respuesta está en los llamados modelos fundacionales.

Un modelo fundacional es un sistema entrenado a gran escala sobre datos amplios y variados, diseñado no para una tarea específica, sino para modelar patrones generales. A partir de ese entrenamiento base, puede adaptarse a múltiples aplicaciones con ajustes mínimos.

No es un modelo especializado. Es una plataforma cognitiva.

Qué es un modelo fundacional

Un modelo fundacional se entrena una vez, a gran escala, y luego se reutiliza para múltiples tareas.

En lugar de crear un modelo para cada función —uno para resumir, otro para traducir, otro para responder preguntas— se entrena un único modelo masivo capaz de ejecutar todas esas tareas mediante instrucciones.

Ese enfoque reduce la fragmentación tecnológica y aumenta la versatilidad.

Pero también introduce concentración de poder computacional. Solo organizaciones con recursos significativos pueden entrenar estos modelos desde cero.

Por qué el escalamiento importa

Aquí volvemos a la palabra “Large”.

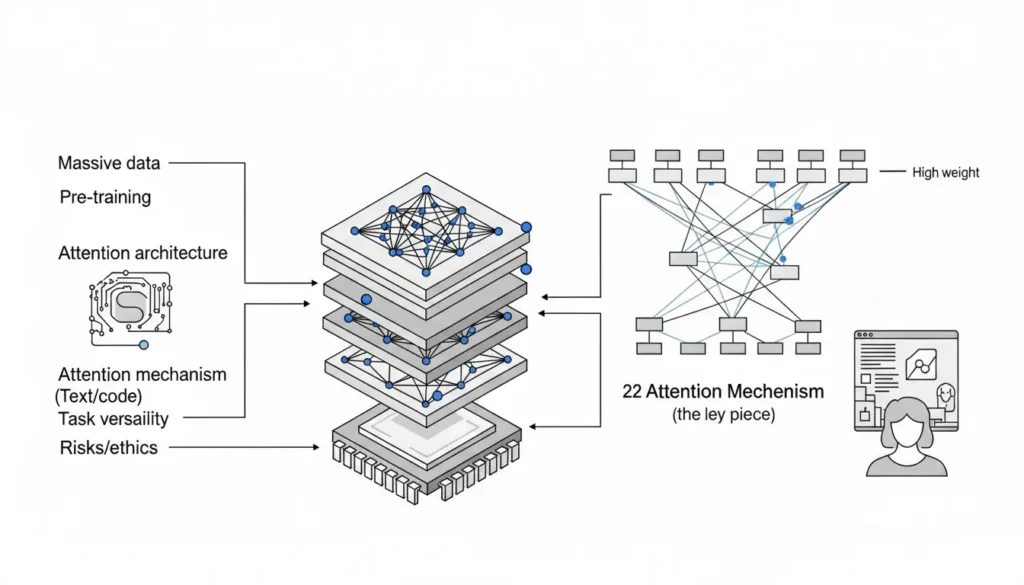

Cuando el número de parámetros crece y el volumen de datos aumenta, el modelo comienza a capturar patrones más abstractos. Esa escala permite que emerjan capacidades que no estaban explícitamente programadas.

No es magia. Es estadística a gran escala.

La combinación de datos masivos, arquitectura avanzada y poder computacional crea sistemas capaces de generalizar con mayor flexibilidad.

Sin ese escalamiento, la IA generativa no existiría tal como la conocemos hoy.

Pero los modelos fundacionales no son homogéneos. Existen distintas arquitecturas que hicieron posible esta evolución.

Arquitecturas que hicieron posible la IA generativa

La Inteligencia Artificial Generativa no nació de una sola arquitectura. Es el resultado de varias líneas de investigación que convergieron hasta alcanzar escala suficiente.

Antes de que los modelos fundacionales dominaran el panorama, distintas estructuras matemáticas exploraron cómo generar datos nuevos a partir de distribuciones aprendidas.

Cada una resolvió un problema específico.

VAE (Variational Autoencoders)

Los VAE fueron uno de los primeros intentos sólidos de modelar distribuciones latentes.

La idea es relativamente elegante: comprimir datos en un espacio latente continuo y luego reconstruirlos desde ese espacio. En lugar de memorizar ejemplos, el modelo aprende una representación comprimida que captura características esenciales.

Eso permite generar nuevas instancias muestreando dentro del espacio latente.

No son perfectos. A menudo producen resultados más suaves o menos definidos. Pero establecieron una base conceptual: generar implica modelar una distribución interna.

GAN (Generative Adversarial Networks)

Las GAN introdujeron una dinámica distinta.

Dos redes compiten: una genera datos y la otra intenta distinguir si son reales o sintéticos. Esa competencia empuja al generador a producir resultados cada vez más realistas.

Este enfoque fue especialmente poderoso en generación de imágenes. Durante años, las GAN dominaron el campo visual.

Pero eran inestables de entrenar y sensibles a ajustes finos.

Modelos de difusión

Más recientemente, los modelos de difusión tomaron protagonismo en generación de imágenes.

Funcionan agregando ruido progresivamente a los datos durante entrenamiento y aprendiendo luego a revertir ese proceso. En lugar de competir como las GAN, aprenden a reconstruir datos desde ruido.

Ese enfoque resultó más estable y escalable, permitiendo avances notables en calidad visual.

Transformers

En el ámbito del lenguaje, los Transformers cambiaron las reglas.

Introducidos en 2017, permitieron procesar secuencias completas mediante mecanismos de atención. Esa arquitectura hizo posible el escalamiento masivo en modelos de texto.

Cuando se combinaron Transformers con datos masivos y entrenamiento a gran escala, emergieron los LLM que hoy sostienen la IA generativa textual.

Cada arquitectura resolvió un obstáculo distinto.

Pero ninguna de ellas por sí sola explica el fenómeno actual.

La convergencia entre arquitectura, datos y capacidad computacional es lo que hizo viable la generación industrial de contenido.

Cómo funciona realmente la generación de contenido

Hasta ahora hemos hablado de arquitectura. Ahora toca entender el proceso operativo. Porque la Inteligencia Artificial Generativa no “improvisa” contenido desde cero. Sigue un flujo estructurado que combina entrenamiento masivo, ajuste fino y optimización contextual.

La generación ocurre en capas.

Primero se entrena el modelo base. Luego se ajusta. Después se condiciona mediante contexto. Y en algunos casos se conecta con fuentes externas.

Nada es espontáneo. Todo es estadístico.

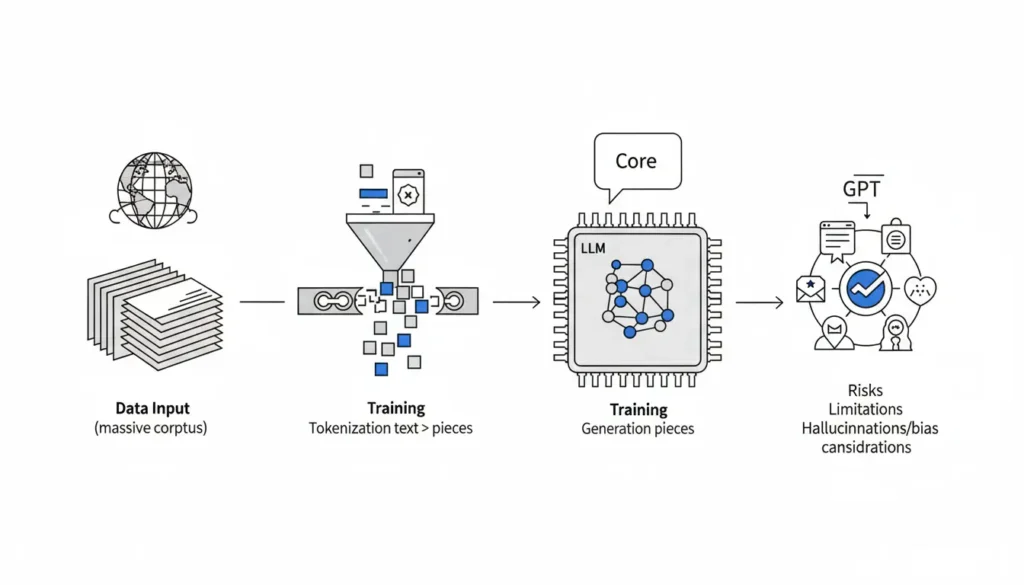

Entrenamiento

El entrenamiento inicial consiste en exponer el modelo a grandes volúmenes de datos para que aprenda patrones generales.

En el caso de modelos de lenguaje, el objetivo suele ser predecir el siguiente token en una secuencia. Esa tarea aparentemente simple, repetida miles de millones de veces, permite que el modelo capture estructuras gramaticales, relaciones semánticas y regularidades discursivas.

No memoriza cada texto. Aprende distribuciones.

Ese entrenamiento es costoso y requiere infraestructura computacional masiva.

Ajuste fino y RLHF

Una vez entrenado el modelo base, se realiza un ajuste fino (fine-tuning). Aquí se optimiza el comportamiento para tareas más específicas o para alinearlo con criterios humanos.

Una técnica clave ha sido el Reinforcement Learning from Human Feedback (RLHF). En este proceso, evaluadores humanos califican respuestas y el modelo ajusta sus parámetros para alinearse mejor con esas preferencias.

Esto no cambia la arquitectura fundamental. Refina el comportamiento.

Permite que el modelo no solo genere texto coherente, sino también texto útil y alineado con expectativas humanas.

RAG como optimización

En algunos sistemas, la generación se combina con Retrieval-Augmented Generation (RAG).

Aquí el modelo no depende exclusivamente de su entrenamiento interno. Recupera información relevante desde bases externas antes de generar la respuesta.

Esto reduce el riesgo de errores factuales y mejora precisión en dominios específicos.

La generación pura se convierte en generación asistida por recuperación.

La creación de contenido por máquinas no es un acto creativo en sentido humano. Es un proceso de predicción condicionado por datos, ajustes y contexto.

Y eso nos lleva a la siguiente pregunta inevitable.

Si estos sistemas pueden generar texto, imagen y código a escala industrial, ¿qué impacto económico y productivo están teniendo realmente?

Eso es lo que analizaremos ahora.

Qué puede crear la IA generativa

Llegados a este punto, ya no estamos hablando de teoría. La Inteligencia Artificial Generativa hoy produce contenido en prácticamente todos los formatos digitales relevantes.

Texto, imágenes, audio, video, código, simulaciones tridimensionales. El rango es amplio. Pero el punto no es la diversidad. Es la convergencia.

Un mismo modelo fundacional puede adaptarse a múltiples salidas con mínimos ajustes. Eso es lo que transforma la generación en infraestructura.

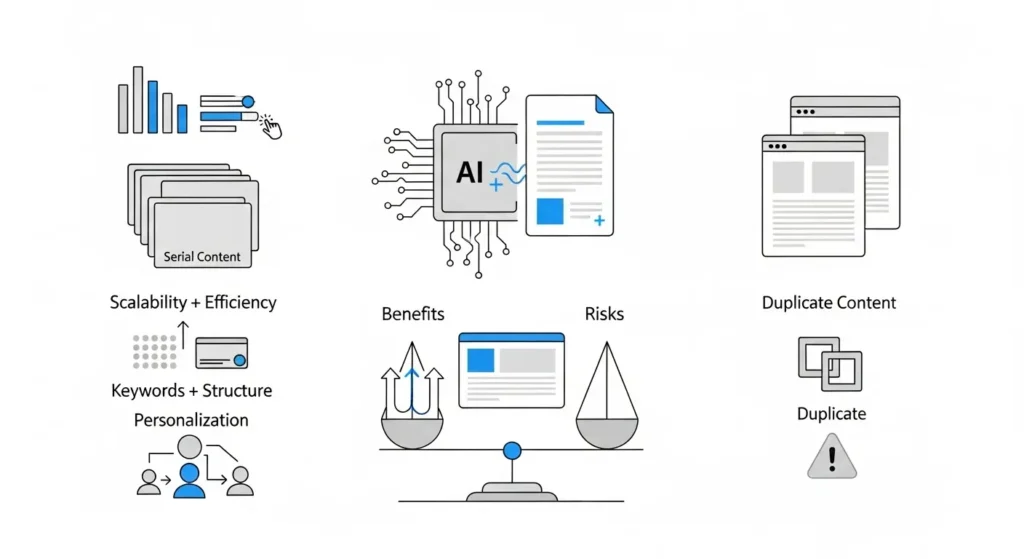

En texto, los modelos pueden redactar artículos, generar resúmenes ejecutivos, producir guiones, estructurar informes técnicos o automatizar respuestas en atención al cliente.

En imagen, pueden crear ilustraciones, arte conceptual, prototipos de diseño o variaciones creativas a partir de instrucciones textuales.

En audio, pueden sintetizar voz natural, componer música o transformar texto en narración.

En código, pueden sugerir funciones, completar estructuras y acelerar procesos de desarrollo.

Pero aquí está el punto crítico.

No crean desde intención consciente. Generan desde probabilidad condicionada.

El resultado puede parecer creativo. El proceso es estadístico.

Impacto económico y productividad global

Cuando la generación de contenido se vuelve automatizable, el efecto no es solo técnico. Es económico.

La IA generativa reduce el costo marginal de producción de información. Lo que antes requería horas humanas ahora puede generarse en segundos.

Eso no elimina la necesidad de criterio humano. Pero sí reconfigura flujos de trabajo.

Empresas comienzan a integrar generación automática en marketing, desarrollo, soporte, análisis documental y diseño conceptual.

El impacto no está en reemplazar completamente al profesional. Está en amplificar productividad.

La pregunta estratégica no es si la IA generativa crea contenido. La pregunta es cómo integrar esa capacidad sin comprometer calidad ni reputación.

Y ahí aparecen los riesgos estructurales.

Riesgos estructurales del contenido creado por máquinas

Si solo hablas de productividad, el análisis queda incompleto. La Inteligencia Artificial Generativa no solo amplifica creación. También amplifica riesgo.

El contenido creado por máquinas no es neutro. Está condicionado por datos de entrenamiento, arquitectura estadística y límites de contexto. Y cuando esa producción se industrializa, los errores también escalan.

No se trata de miedo. Se trata de comprender estructura.

Alucinaciones

Uno de los fenómenos más conocidos es la llamada “alucinación”.

Un modelo generativo puede producir información falsa con apariencia convincente. No lo hace por intención. Lo hace porque predice el siguiente token más probable sin verificar factualmente la respuesta.

Si el patrón estadístico sugiere coherencia, el modelo continúa.

No hay mecanismo interno de verificación de verdad. Hay probabilidad.

Sesgo

Los modelos aprenden de grandes volúmenes de datos públicos y privados. Esos datos contienen sesgos culturales, ideológicos y estructurales.

Cuando el modelo genera contenido, puede reproducir esos sesgos de forma implícita.

El problema no es solo técnico. Es social. La escala convierte sesgos individuales en fenómenos amplificados.

Caja negra

Los LLM y otros modelos generativos operan con millones o miles de millones de parámetros.

Eso dificulta explicar exactamente por qué una respuesta fue generada de determinada manera.

La opacidad estructural complica auditoría, regulación y responsabilidad.

Deepfakes y manipulación

En el ámbito visual y audiovisual, la generación sintética permite crear imágenes, voces o videos que parecen reales.

La capacidad técnica supera la capacidad social de verificación.

El riesgo no es la tecnología en sí. Es el uso malintencionado a gran escala.

Propiedad intelectual

Cuando un modelo aprende de grandes corpus de datos, surge una pregunta compleja: ¿quién posee el contenido generado?

Si el modelo fue entrenado con obras existentes, ¿hasta qué punto la generación es original?

Este debate aún no tiene resolución global clara.

La IA generativa no es inherentemente dañina. Pero su impacto depende de gobernanza, uso responsable y comprensión técnica.

Y aquí llegamos al punto estratégico final.

No basta con adoptar la tecnología. Hay que integrarla sin erosionar credibilidad.

Cómo adoptar IA generativa sin destruir tu reputación

Adoptar Inteligencia Artificial Generativa no es cuestión de instalar una herramienta y empezar a producir contenido en masa. Si lo haces así, el resultado será volumen sin criterio. Y el volumen sin criterio erosiona confianza.

La clave no está en automatizar más. Está en automatizar con estructura.

Primero, define el rol de la IA dentro de tu proceso. ¿Es asistente de borradores? ¿Es generador de ideas? ¿Es herramienta de análisis? No todas las tareas deben delegarse al mismo nivel.

Segundo, implementa revisión humana real. No superficial. El contenido generado debe pasar por validación factual, ajuste de tono y alineación estratégica. La IA amplifica productividad, pero la responsabilidad sigue siendo humana.

Tercero, establece políticas internas claras. Define qué tipo de contenido puede generarse automáticamente y cuál requiere intervención directa. Esto reduce riesgo reputacional y crea coherencia.

Cuarto, integra sistemas de verificación cuando sea necesario. En contextos sensibles —información técnica, financiera o médica— la generación debe complementarse con recuperación de fuentes verificadas.

Adoptar IA generativa sin gobernanza es una receta para inconsistencias.

Adoptarla con estructura es una ventaja competitiva.

La IA generativa como nueva infraestructura cognitiva

Si analizas todo el recorrido, la conclusión es clara.

La Inteligencia Artificial Generativa no es solo una herramienta creativa. Es la industrialización de la producción simbólica. Texto, imagen, audio y código pueden generarse a escala con una eficiencia sin precedentes.

Pero esa capacidad no elimina la necesidad de criterio. La multiplica.

La tecnología ya es infraestructura. Está integrada en plataformas, flujos de trabajo y productos digitales. La pregunta no es si existirá. La pregunta es cómo la gestionas.

Quien la adopte sin estructura generará ruido.

Quien la adopte con estrategia construirá ventaja.

La diferencia no está en la máquina. Está en la arquitectura que construyes alrededor de ella.