¿Qué es GoogleBot?

Cuando alguien pregunta qué es GoogleBot, suele recibir una respuesta simplificada: “es el robot de Google que rastrea páginas web”. Es correcta, pero insuficiente.

GoogleBot no es solo un visitante automático. Es el primer filtro operativo dentro del ecosistema de Google. Si no puede acceder, interpretar y procesar tu contenido, tu página no entra en competencia.

Antes de indexación.

Antes de ranking.

Antes de cualquier estrategia.

GoogleBot es la puerta.

Aquí está la hipótesis que debes asumir desde el inicio: GoogleBot no determina si posicionas, pero sí determina si tienes derecho a competir.

Si no puede rastrear tu contenido correctamente, el resto del sistema nunca lo evaluará.

GoogleBot no es solo un rastreador

Pensar en GoogleBot como un simple “crawler” es quedarse corto.

GoogleBot cumple varias funciones:

- Descubre URLs a través de enlaces.

- Solicita contenido a tu servidor.

- Procesa HTML inicial.

- Renderiza recursos cuando es necesario.

- Detecta señales técnicas.

- Evalúa accesibilidad estructural.

No se limita a descargar páginas. Intenta entenderlas.

Y lo hace bajo condiciones técnicas específicas: límites de procesamiento, prioridades de rastreo y modelo mobile-first.

GoogleBot no rastrea todo con la misma profundidad ni con la misma frecuencia.

Rastrea según señales.

Por eso, comprender cómo funciona realmente es clave para cualquier estrategia SEO.

En la siguiente sección vamos a entrar en el funcionamiento técnico real de GoogleBot y qué implica eso para tu arquitectura.

Cómo funciona realmente GoogleBot

Si quieres entender qué es GoogleBot en términos prácticos, necesitas verlo como un sistema distribuido que opera bajo reglas técnicas claras, no como un robot ingenuo que visita páginas al azar.

GoogleBot descubre URLs principalmente a través de enlaces internos y externos. Cada enlace es una señal de descubrimiento y de prioridad. Cuando encuentra una nueva URL, envía una solicitud HTTP a tu servidor y recibe una respuesta. Esa respuesta no solo contiene contenido. Contiene señales.

Código de estado.

Tiempo de respuesta.

Encabezados.

Estructura HTML.

Todo eso influye en el siguiente paso.

Mobile-first indexing

Desde que Google adoptó el modelo mobile-first, GoogleBot prioriza la versión móvil de tu sitio para evaluar contenido.

Si tu versión móvil es limitada, oculta contenido relevante o depende excesivamente de scripts que no renderizan correctamente, la interpretación puede quedar incompleta.

No es que Google “prefiera móviles”. Es que evalúa desde esa perspectiva como base principal.

Tu SEO ya no se define desde escritorio.

Se define desde la experiencia móvil procesada por GoogleBot.

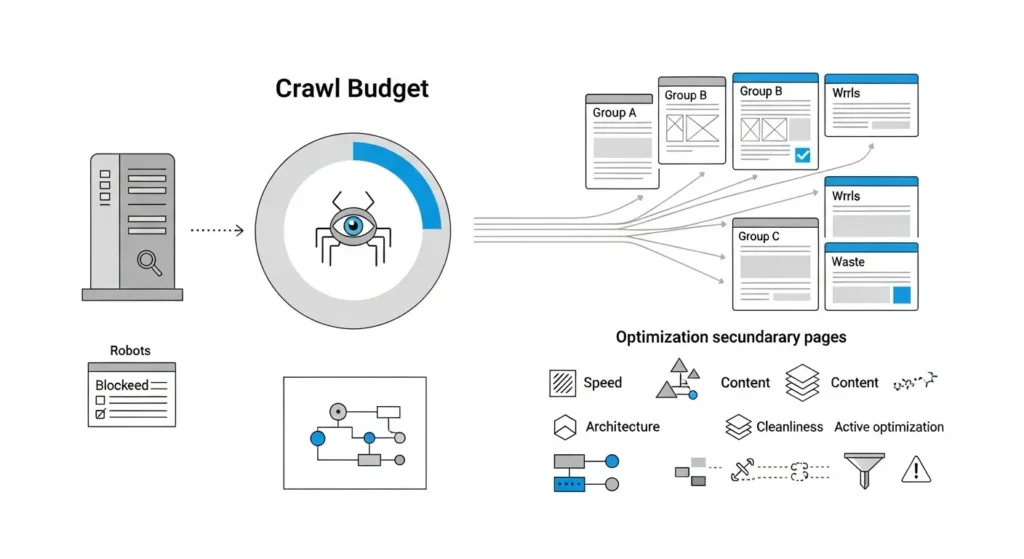

Límite de rastreo y procesamiento

GoogleBot no procesa infinitamente.

Existe un límite práctico de procesamiento por página. Si tu HTML es excesivamente pesado o depende de múltiples recursos bloqueados, el renderizado puede quedar parcial.

Además, el rastreo se ajusta según la estabilidad de tu servidor. Si detecta errores frecuentes o tiempos de carga altos, reduce la intensidad.

GoogleBot no quiere saturar tu infraestructura.

Quiere eficiencia.

El funcionamiento de GoogleBot no es lineal ni ingenuo.

Es adaptativo.

Y eso nos lleva a una pregunta estratégica clave.

¿Qué puede ver realmente GoogleBot y qué puede quedar fuera de su alcance?

Qué puede ver y qué no puede ver GoogleBot

Aquí es donde la teoría se vuelve práctica.

Entender qué es GoogleBot no basta. Necesitas entender sus límites. Porque muchas veces el problema no es que tu contenido sea malo. Es que GoogleBot no lo está viendo como tú crees.

GoogleBot puede ver:

- HTML renderizado.

- Texto visible en el DOM final.

- Enlaces internos correctamente estructurados.

- Recursos que no estén bloqueados.

- Datos estructurados bien implementados.

Pero no siempre puede ver lo que depende de:

- JavaScript que se ejecuta tarde o falla.

- Contenido cargado tras interacción del usuario.

- Recursos bloqueados por robots.txt.

- Parámetros infinitos que generan versiones inconsistentes.

- Contenido oculto que no se renderiza correctamente en móvil.

Y aquí está el punto crítico.

Tú ves la página final en tu navegador.

GoogleBot ve lo que logra procesar bajo sus propios límites técnicos.

Si hay discrepancia, el problema no es percepción. Es arquitectura.

En entornos con frameworks JavaScript pesados, renderizado del lado del cliente o recursos críticos bloqueados, el contenido puede no consolidarse en el momento en que GoogleBot lo procesa.

Y si no lo procesa correctamente, la indexación se debilita.

No es penalización.

Es falta de acceso efectivo.

Por eso, cuando hablamos de SEO técnico moderno, no basta con escribir buen contenido.

Debes garantizar que GoogleBot pueda verlo, interpretarlo y contextualizarlo.

Y eso nos lleva al siguiente nivel.

Cómo interactúa GoogleBot con tu arquitectura interna y qué decisiones estructurales influyen directamente en su comportamiento.

Cómo interactúa GoogleBot con tu arquitectura

Si ya entendiste qué es GoogleBot y qué puede ver, ahora toca asumir algo más incómodo: tu arquitectura le dice a GoogleBot qué es importante y qué no.

GoogleBot no tiene intuición editorial. Interpreta señales estructurales.

Cada enlace interno, cada profundidad de clic, cada redirección innecesaria y cada parámetro dinámico construyen un mapa mental de tu sitio.

Y ese mapa determina prioridad.

Enlazado interno

GoogleBot sigue enlaces.

Si una página recibe múltiples enlaces internos desde zonas estratégicas, la interpreta como relevante. Si está aislada o enterrada en múltiples niveles de navegación, su prioridad disminuye.

El enlazado interno no solo distribuye autoridad. Define rutas de rastreo.

Una arquitectura plana facilita descubrimiento. Una arquitectura caótica dispersa recursos.

No es casualidad que los sitios mejor estructurados tengan indexación más estable.

JavaScript y renderizado

Aquí es donde muchos proyectos modernos fallan.

Si dependes exclusivamente de renderizado del lado del cliente, GoogleBot primero descarga el HTML inicial y luego, en una segunda fase, ejecuta JavaScript para procesar contenido dinámico.

Ese segundo paso no siempre ocurre de inmediato.

Puede haber retraso.

Si el contenido crítico solo aparece tras ejecución tardía, el rastreo inicial puede no capturarlo completamente.

No es que GoogleBot no soporte JavaScript. Es que el procesamiento no es infinito.

Optimizar renderizado es optimizar visibilidad.

Robots.txt y etiquetas noindex

Bloquear mal es más peligroso que no bloquear.

Si impides acceso a recursos críticos o secciones completas sin análisis previo, puedes cortar rutas de rastreo esenciales.

El robots.txt controla acceso.

La etiqueta noindex controla inclusión en índice.

Confundir ambas genera errores estratégicos.

GoogleBot sigue instrucciones técnicas con precisión. El problema es cuando las instrucciones están mal diseñadas.

Tu arquitectura no es un diseño estético.

Es el entorno operativo donde el Bot toma decisiones.

Y cuando bloqueas, rediriges o estructuras mal, no estás confundiendo a un robot simple.

Estás alterando el primer filtro del sistema de búsqueda.

Errores estratégicos al bloquear GoogleBot

Aquí es donde muchos proyectos se disparan en el pie sin darse cuenta.

Creen que optimizar es bloquear.

Creen que controlar rastreo es cerrar puertas.

Y terminan limitando a GoogleBot más de lo que deberían.

El problema no es proteger recursos. El problema es bloquear sin entender consecuencias.

Uno de los errores más comunes es usar robots.txt para intentar desindexar contenido.

Si bloqueas una URL en robots.txt, el robot de Google no puede rastrearla. Pero si esa URL ya estaba indexada, puede permanecer en el índice sin que Google pueda actualizarla o eliminarla correctamente.

Bloquear no es igual a desindexar.

Son funciones distintas.

Otro error frecuente es bloquear recursos críticos como archivos CSS o JavaScript.

Si el Bot no puede renderizar correctamente la página porque los recursos están bloqueados, la interpretación del contenido puede quedar incompleta.

Y si la interpretación es incompleta, la evaluación también lo será.

No es una penalización directa.

Es una degradación silenciosa de señales.

También existe el abuso del noindex.

Aplicarlo masivamente sin segmentación estratégica puede reducir autoridad interna, romper clústeres temáticos y debilitar arquitectura.

El control técnico debe ser quirúrgico.

No reactivo.

El robot de Google no necesita ser combatido.

Necesita claridad.

Cuando bloqueas sin diagnóstico, introduces fricción innecesaria en el primer filtro operativo del buscador.

Y esa fricción puede impactar indexación, priorización y visibilidad sin que lo detectes inmediatamente.

Ahora podemos cerrar el círculo.

Porque el robot de Google no es el enemigo.

Es el punto de entrada al sistema.

Y entender eso cambia la estrategia por completo.

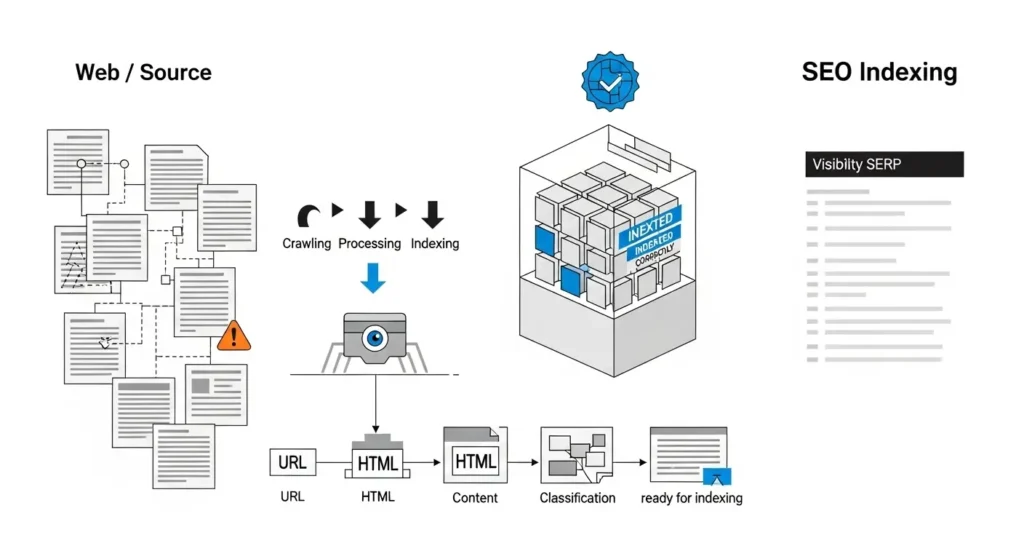

GoogleBot es el filtro operativo

Si analizas todo el recorrido, ya deberías tener clara una idea fundamental.

GoogleBot no posiciona.

GoogleBot no decide rankings finales.

Pero GoogleBot decide si entras al sistema.

Es el primer filtro operativo.

Si no puede rastrear correctamente tu contenido, no hay indexación.

Si no hay indexación sólida, no hay competencia real.

Y si no compites, el resto del algoritmo nunca entra en juego.

Muchos proyectos SEO intentan optimizar señales avanzadas mientras ignoran cómo interactúa con su arquitectura. Trabajan autoridad, contenido y enlaces externos, pero descuidan accesibilidad estructural.

Y el sistema es secuencial.

Primero rastreo.

Luego procesamiento.

Luego indexación.

Luego evaluación de calidad.

Luego ranking.

GoogleBot es la puerta de entrada a todo ese flujo.

No es un robot simple. Es un sistema adaptativo que responde a señales técnicas, estructurales y de eficiencia.

Si tu arquitectura es clara, tu servidor es estable y tu contenido es accesible, el robot de Google fluye.

Si introduces fricción innecesaria, el sistema se ralentiza.

En SEO moderno, no basta con crear contenido.

Debes garantizar que el primer filtro pueda verlo, entenderlo y procesarlo sin obstáculos.

Porque antes de competir, tienes que ser elegible.

Y GoogleBot es quien valida esa elegibilidad.