Cloaking SEO: Evita penalizaciones

- Cloaking SEO: Evita penalizaciones

Hablar de cloaking SEO no es hablar de una técnica avanzada. Es hablar de una práctica que puede destruir años de trabajo en cuestión de días.

Durante mucho tiempo, algunos intentaron manipular el algoritmo mostrando un contenido al buscador y otro diferente al usuario. Funcionó, en ciertos momentos. Pero el SEO moderno ya no tolera esa incoherencia.

Hoy, Google no solo rastrea. Compara.

Y cuando detecta diferencias sustanciales entre lo que ve el bot y lo que ve el usuario, activa señales de spam que pueden terminar en penalización manual o pérdida algorítmica de visibilidad.

El cloaking no es una optimización arriesgada.

Es una violación directa de las directrices.

Pero para entender por qué es tan grave, primero debemos aclarar exactamente qué es el cloaking SEO y qué no lo es.

Qué es el cloaking SEO realmente

El cloaking SEO ocurre cuando un sitio web muestra contenido diferente al usuario y al motor de búsqueda con la intención de manipular el posicionamiento.

No es una variación estética.

No es adaptación responsive.

Es una discrepancia intencional entre versiones.

En términos técnicos, el servidor identifica quién está solicitando la página —ya sea un bot de Google o un usuario real— y responde con versiones distintas del contenido.

Esa diferencia es el núcleo del problema.

Definición técnica actual

Google define cloaking como la práctica de presentar contenido distinto a los usuarios y a los motores de búsqueda con el fin de engañar.

Esto puede incluir:

- Mostrar texto optimizado solo al bot.

- Ocultar palabras clave al usuario.

- Redirigir a una página diferente tras la indexación.

- Manipular contenido mediante scripts según el user-agent.

El punto clave es la intención.

Si la diferencia busca mejorar experiencia sin alterar significado, no es cloaking.

Si la diferencia altera el contenido con fines de ranking, sí lo es.

Diferencia entre personalización legítima y cloaking

Aquí está la zona gris donde muchos se confunden.

Mostrar contenido según idioma o ubicación no es cloaking si el contenido principal mantiene coherencia.

Por ejemplo:

- Adaptar moneda según país.

- Cambiar idioma según configuración.

- Mostrar diseño distinto en móvil.

Eso es personalización.

El problema aparece cuando el contenido esencial cambia.

Si el bot ve una página cargada de palabras clave y el usuario ve una versión limpia o distinta, estamos ante cloaking.

El SEO moderno exige coherencia estructural.

Lo que el bot interpreta debe ser equivalente a lo que el usuario consume.

Pero entender la definición no es suficiente.

Ahora debemos analizar cómo funciona técnicamente el cloaking detrás del servidor.

Cómo funciona el cloaking a nivel técnico

El cloaking SEO no es un truco superficial. Es una manipulación a nivel de servidor o de renderizado que altera la respuesta según quién solicita la página.

Para comprender el riesgo, debes entender el proceso.

Cuando alguien accede a una URL, el servidor recibe información como:

- User-Agent

- Dirección IP

- Encabezados HTTP

- Tipo de dispositivo

Con esos datos, puede decidir qué versión mostrar.

Ahí es donde empieza el problema.

User-Agent y detección por IP

El método más clásico consiste en identificar el user-agent de Googlebot.

Si el servidor detecta que la solicitud proviene de un bot, muestra una versión optimizada con palabras clave, texto adicional o contenido que no está visible para usuarios reales.

Si detecta un navegador común, muestra otra versión.

También puede hacerse por IP, permitiendo acceso a cierto contenido solo cuando la IP pertenece a rangos conocidos de motores de búsqueda.

El sistema parece sofisticado.

Pero para Google, es una discrepancia directa.

Manipulación vía JavaScript y renderizado

En el SEO moderno, el cloaking no siempre ocurre en el servidor. Puede ocurrir en el renderizado.

Algunos sitios cargan contenido dinámico mediante JavaScript que:

- Detecta bots.

- Oculta bloques de texto.

- Muestra versiones alternativas.

Con la evolución del renderizado en Google (WRS – Web Rendering Service), estas manipulaciones son cada vez más detectables.

El buscador ahora ejecuta JavaScript, compara versiones y analiza coherencia.

Redirecciones encubiertas

Otra forma común es mostrar una página indexable al bot y luego redirigir al usuario a otra URL distinta.

Por ejemplo:

- Google indexa una página con contenido informativo.

- El usuario termina en una página comercial diferente.

Esto es una forma clara de cloaking.

El patrón siempre es el mismo:

Contenido A para el bot.

Contenido B para el usuario.

Y en el SEO actual, esa incoherencia activa alertas automáticas.

Ahora debemos entender algo más importante aún:

¿Por qué Google penaliza el cloaking con tanta severidad?

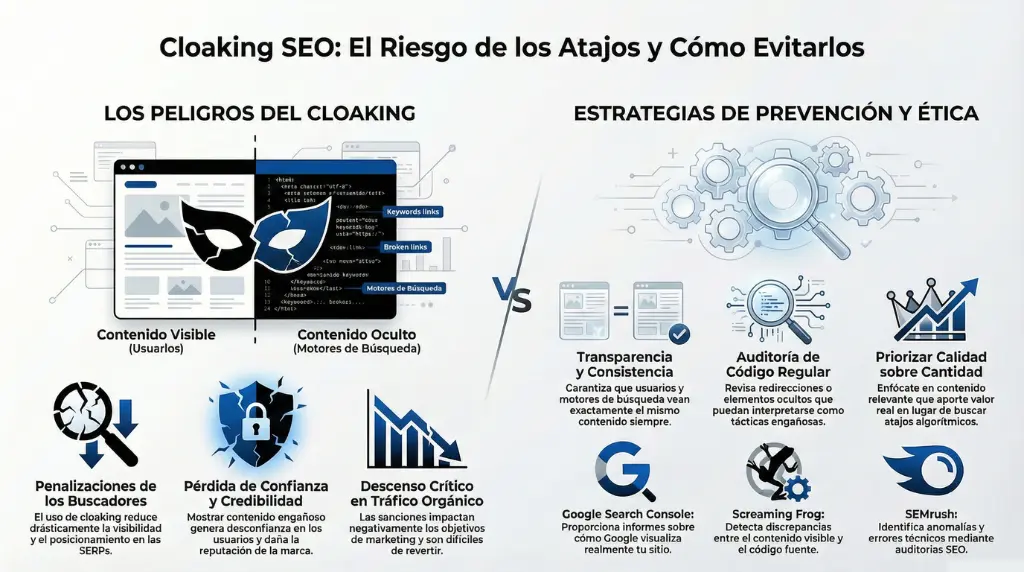

Por qué Google penaliza el cloaking

El cloaking SEO no es simplemente una mala práctica. Es una ruptura directa del principio fundamental del buscador: ofrecer al usuario exactamente lo que promete el resultado.

Google no penaliza el cloaking por capricho. Lo penaliza porque distorsiona la confianza del sistema.

Si el buscador muestra un resultado basado en un contenido específico y el usuario aterriza en algo distinto, la experiencia se rompe. Y cuando la experiencia se rompe, la credibilidad del motor también se ve afectada.

Por eso la reacción es severa.

Directrices oficiales y SpamBrain

Las directrices de calidad de Google son claras: mostrar contenido diferente a los usuarios y a los motores de búsqueda con intención de manipulación es una infracción.

En el entorno actual, donde opera SpamBrain, el sistema no solo detecta palabras clave forzadas. Detecta patrones de comportamiento engañoso.

SpamBrain analiza señales como:

- Diferencias sustanciales en renderizado.

- Redirecciones inconsistentes.

- Cambios dinámicos según agente.

No es un sistema basado únicamente en coincidencias. Es aprendizaje automático aplicado a patrones de spam.

Penalización manual vs algorítmica

Aquí está el punto crítico.

El cloaking puede generar:

- Acción manual: revisión humana que deriva en penalización directa.

- Penalización algorítmica: pérdida progresiva de visibilidad sin aviso explícito.

La acción manual suele aparecer en Search Console.

La algorítmica se manifiesta como caída repentina de tráfico.

En ambos casos, la recuperación no es inmediata.

Google penaliza el cloaking porque rompe la equivalencia entre intención de búsqueda y contenido real. Y en el SEO moderno, esa equivalencia es sagrada.

Pero hay algo aún más delicado.

No todo cloaking es intencional.

Y ahí es donde muchos sitios cometen errores sin saberlo.

Casos comunes donde ocurre cloaking sin querer

No todo cloaking SEO nace de una intención manipuladora. En muchos casos, es consecuencia de configuraciones mal implementadas.

Y ese es el problema real.

Porque Google no evalúa tu intención. Evalúa el resultado.

Si el bot ve algo distinto al usuario, la señal se activa. Punto.

Plugins mal configurados

Algunos plugins de optimización, caché o geolocalización pueden generar versiones diferentes según el tipo de visitante.

Por ejemplo:

- Mostrar contenido enriquecido solo cuando detecta Googlebot.

- Servir versión simplificada a usuarios móviles.

- Alterar bloques dinámicos sin coherencia estructural.

Si la diferencia afecta el contenido principal, puede interpretarse como cloaking.

La automatización sin supervisión es una de las causas más frecuentes.

Geolocalización agresiva

Personalizar contenido según país es legítimo. El problema aparece cuando la geolocalización cambia sustancialmente el mensaje.

Ejemplo:

- El bot recibe contenido informativo.

- El usuario en cierto país recibe una página promocional distinta.

Si el contenido central cambia, no es adaptación. Es inconsistencia.

Implementaciones mal hechas de contenido dinámico

El uso de JavaScript, frameworks SPA o renderizado híbrido puede generar discrepancias.

Si el servidor envía HTML vacío y el contenido real se carga solo tras interacción del usuario, pero el bot interpreta algo diferente, se crea una brecha.

Con el renderizado moderno de Google, estas diferencias son cada vez más visibles.

El punto crítico es este:

Cloaking no siempre es una estrategia.

A veces es un error técnico acumulado.

Y por eso la prevención comienza con auditoría.

Ahora debemos pasar al siguiente nivel: cómo detectar si tu sitio está incurriendo en cloaking.

Cómo detectar cloaking en tu sitio

El mayor error con el cloaking SEO es asumir que, si no lo hiciste intencionalmente, no existe.

Pero el SEO moderno no se basa en suposiciones. Se basa en comprobaciones.

Detectar cloaking implica comparar lo que ve Google con lo que ve el usuario. Si hay diferencias sustanciales, hay un problema.

1. Inspección de URL en Search Console

La herramienta de inspección permite ver:

- HTML renderizado.

- Captura de pantalla procesada por Google.

- Recursos cargados.

Aquí debes comparar esa versión con lo que ves en tu navegador en modo incógnito.

Si el contenido principal difiere, la alerta es inmediata.

La inspección no es opcional. Es obligatoria en auditorías técnicas.

2. Comparación de user-agent

Una práctica sencilla pero efectiva es simular el user-agent de Googlebot.

Existen herramientas y extensiones que permiten cambiar el agente del navegador y ver cómo responde el servidor.

Si al cambiar el user-agent aparece contenido diferente, hay riesgo.

La coherencia debe mantenerse independientemente del visitante.

3. Rastreo comparativo

Utilizar herramientas de crawling para comparar:

- HTML bruto.

- HTML renderizado.

- Contenido visible.

En sitios con JavaScript pesado, esta comparación es crítica.

Si el bot recibe una versión distinta por problemas de renderizado, Google puede interpretarlo como cloaking aunque no haya intención.

El diagnóstico no termina cuando confirmas que todo está correcto.

Debe formar parte de un protocolo preventivo.

Porque el cloaking no siempre aparece por estrategia. A veces surge tras actualizaciones, cambios de servidor o implementación de nuevos plugins.

Ahora pasamos a la parte clave:

Cómo evitar penalizaciones antes de que ocurran.

Cómo evitar penalizaciones por cloaking SEO

Si entendiste lo anterior, sabes algo esencial: el cloaking SEO no se combate cuando ya hay penalización. Se previene desde la arquitectura.

La regla es simple.

Lo que ve el bot debe ser equivalente a lo que ve el usuario.

No idéntico en píxel.

Equivalente en contenido.

Transparencia técnica como principio

Evita cualquier lógica condicional basada en:

- User-agent.

- IP del visitante.

- Detección explícita de bots.

Si necesitas personalización, que sea contextual, no estructural.

Cambiar idioma o moneda es válido.

Cambiar el contenido central no lo es.

La coherencia semántica es la base del SEO sostenible.

Auditoría preventiva periódica

El cloaking muchas veces aparece después de:

- Actualizaciones de plugins.

- Cambios en CDN.

- Implementaciones de caché.

- Migraciones de servidor.

Por eso debes integrar revisiones periódicas:

- Inspección en Search Console.

- Comparación de renderizado.

- Verificación de HTML servido.

La prevención no es puntual. Es rutina.

Buenas prácticas sostenibles

- Usa renderizado híbrido correctamente.

- Evita contenido oculto que no tenga sentido UX.

- No generes bloques invisibles con intención SEO.

- Documenta cualquier personalización implementada.

En el SEO actual, la manipulación a corto plazo no compensa el riesgo a largo plazo.

El algoritmo evoluciona.

La penalización puede tardar.

Pero la incoherencia siempre termina detectándose.

Y ahí es donde se define la diferencia entre estrategia y atajo.

SEO sostenible vs atajos peligrosos

El cloaking SEO no es una técnica avanzada. Es un síntoma de una mentalidad equivocada.

Quien recurre al cloaking busca acelerar resultados manipulando la percepción del algoritmo. Pero el SEO moderno ya no se basa en engañar. Se basa en coherencia.

Google evolucionó desde detectar palabras clave hasta interpretar intención, contexto y comportamiento. En ese entorno, cualquier discrepancia deliberada entre bot y usuario activa sospecha.

El atajo parece atractivo porque promete rapidez.

Pero la penalización suele ser lenta, silenciosa y devastadora.

El SEO sostenible, en cambio, se construye sobre equivalencia:

- El contenido que indexa Google es el que consume el usuario.

- La intención de búsqueda se satisface sin distorsión.

- La experiencia es consistente en todos los dispositivos.

No se trata de optimizar más.

Se trata de optimizar correctamente.

En un ecosistema donde operan sistemas como SpamBrain y el Helpful Content System, la transparencia ya no es opcional. Es requisito.

El cloaking pertenece a una etapa antigua del posicionamiento.

La coherencia pertenece al presente.

Y en el SEO actual, quien apuesta por coherencia construye activos.

Quien apuesta por atajos construye riesgo.