Evita estas 10 técnicas de Black Hat SEO

- Evita estas 10 técnicas de Black Hat SEO

- Qué es realmente el Black Hat SEO y por qué sigue existiendo

- Cómo Google detecta el Black Hat SEO en 2026

- Las 10 técnicas de Black Hat SEO que debes evitar

- Qué ocurre cuando Google detecta prácticas Black Hat SEO

- Estrategia alternativa: Cómo competir sin manipular

- El costo real de intentar engañar al algoritmo

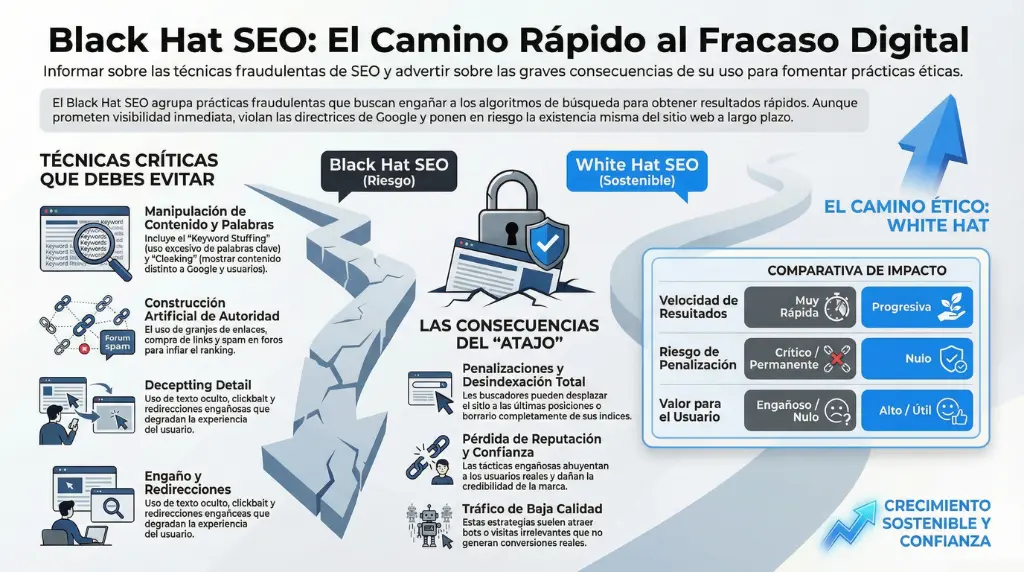

El Black Hat SEO no es una estrategia avanzada. Es una apuesta de alto riesgo disfrazada de crecimiento rápido. Y si estás compitiendo en SERPs exigentes, entender esto no es opcional. Es estructural.

Muchos proyectos creen que el problema del posicionamiento es falta de agresividad. No es cierto. El problema suele ser falta de coherencia estratégica. El Black Hat SEO aparece cuando se intenta forzar resultados sin construir autoridad. Cuando el tráfico se convierte en obsesión y la experiencia en una variable secundaria.

Aquí está el punto incómodo: durante años, muchas técnicas manipulativas funcionaron. Generaron rankings. Inflaron dominios. Construyeron imperios temporales. Pero el algoritmo no es estático. Evoluciona. Aprende. Ajusta.

Y hoy el margen de error es mínimo.

Este artículo no es una lista superficial de prácticas prohibidas. Es un análisis estratégico para que entiendas qué técnicas de Black Hat SEO debes evitar, cómo Google las detecta en 2026 y por qué el costo real no es una penalización puntual, sino la pérdida progresiva de autoridad.

Si estás construyendo un proyecto serio, necesitas entender esto desde la raíz.

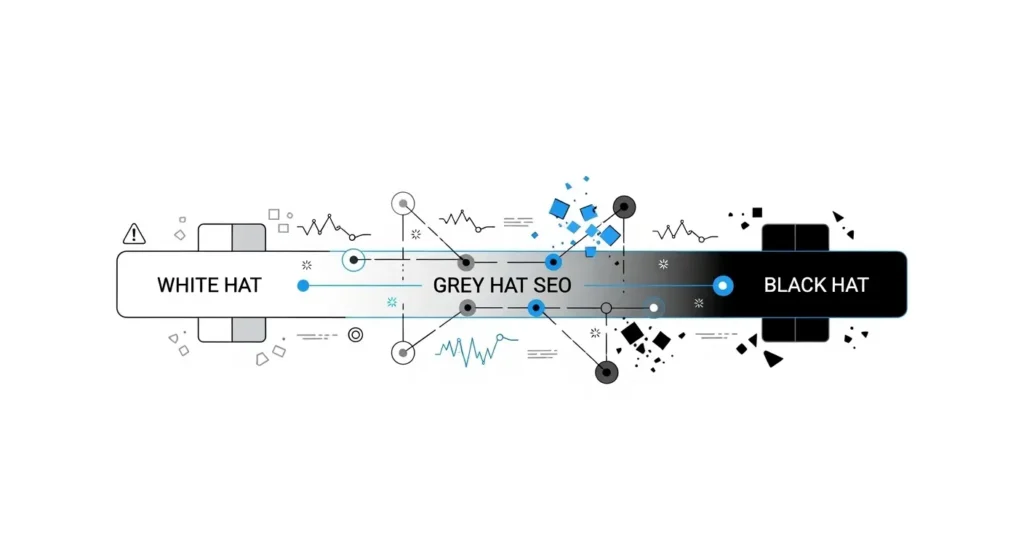

Qué es realmente el Black Hat SEO y por qué sigue existiendo

El Black Hat SEO es el conjunto de prácticas diseñadas para manipular el algoritmo en lugar de satisfacer la intención de búsqueda. No nace de la optimización técnica. Nace de la obsesión por acelerar resultados. Y cuando confundes velocidad con estrategia, empiezas a construir sobre terreno inestable.

El dolor es claro. Competencia alta, presión por tráfico, clientes impacientes, métricas que no crecen al ritmo esperado. En ese contexto, las tácticas agresivas parecen una solución lógica. Insertar más palabras clave. Comprar enlaces. Generar contenido masivo. Automatizar señales. Todo promete impulso inmediato.

Sin embargo, el análisis profundo muestra otra cosa. El Black Hat SEO opera sobre vulnerabilidades temporales del sistema. Pero Google ya no depende de reglas estáticas. Opera con sistemas de aprendizaje, análisis de patrones y validación de comportamiento de usuario. Cuando detecta inconsistencias estructurales, ajusta visibilidad.

La diferencia estratégica es radical. Optimizar significa mejorar relevancia real. Manipular significa simularla. Uno fortalece activos digitales. El otro los expone a volatilidad algorítmica. Y en mercados competitivos, la volatilidad es el enemigo silencioso.

Diferencia estructural entre manipulación y optimización

Optimizar implica alinear contenido, arquitectura y autoridad con intención de búsqueda. Manipular implica inflar señales para aparentar relevancia. La distinción no es moral. Es técnica.

Cuando trabajas optimización, cada mejora tiene coherencia interna: estructura semántica clara, enlaces contextuales naturales, profundidad temática sostenida. El algoritmo interpreta consistencia. Cuando manipulas, introduces señales desconectadas: enlaces sin contexto, densidades artificiales, páginas creadas solo para capturar impresiones.

Google no evalúa páginas aisladas. Evalúa ecosistemas completos. Si detecta patrones repetitivos orientados exclusivamente a capturar rankings sin aportar valor real, reduce peso algorítmico. No siempre hay penalización visible. A veces hay algo más complejo: pérdida progresiva de capacidad de escalar.

Ese estancamiento suele confundirse con “competencia fuerte”. En realidad, es pérdida de confianza algorítmica.

Por qué el Black Hat SEO sigue existiendo

Si el riesgo es tan evidente, ¿por qué sigue practicándose? Porque ofrece una narrativa seductora: crecimiento rápido sin construcción lenta de autoridad.

En proyectos nuevos, la comparación constante con competidores consolidados genera ansiedad estratégica. Se buscan atajos, prueban esquemas agresivos, se compran señales externas. Lo que no se mide es el impacto a mediano plazo.

Los sistemas actuales analizan evolución histórica del dominio, consistencia temática y comportamiento de usuarios. Un crecimiento abrupto sin respaldo estructural activa recalibraciones. El algoritmo no necesita castigar de inmediato. Basta con ajustar confianza.

Y recuperar confianza algorítmica es mucho más lento que perderla.

Cómo Google detecta el Black Hat SEO en 2026

Si todavía crees que el Black Hat SEO se detecta con reglas simples, estás operando con un modelo mental de hace diez años. El algoritmo actual no funciona por listas rígidas de prohibiciones. Funciona por identificación de patrones.

El dolor aquí es estratégico. Muchos proyectos piensan que pueden “disfrazar” prácticas manipulativas haciéndolas más sutiles. Menos densidad forzada. Enlaces más variados. Contenido generado masivamente pero “revisado”. El problema es que Google ya no analiza solo la superficie. Analiza coherencia, evolución histórica y comportamiento agregado.

En 2026, la detección del Black Hat SEO descansa principalmente en sistemas automatizados que operan en paralelo. No es un único filtro. Es un ecosistema de validación continua.

SpamBrain y la detección automática de manipulación

SpamBrain es el sistema de inteligencia artificial diseñado para detectar patrones de spam a escala masiva. No evalúa solo un enlace o una página. Evalúa redes completas, comportamientos repetitivos y anomalías estadísticas.

Si un dominio recibe un crecimiento abrupto de enlaces desde sitios sin contexto temático coherente, el sistema lo detecta. Si múltiples páginas comparten estructuras artificiales diseñadas únicamente para capturar tráfico, también lo identifica. No necesita intervención manual.

Aquí ocurre algo clave: SpamBrain no siempre penaliza de forma visible. Muchas veces simplemente neutraliza el efecto de las señales manipuladas. El resultado no es caída dramática. Es pérdida de impulso.

Esa neutralización silenciosa es más común que la penalización pública.

Helpful Content y la evaluación de valor real

El sistema Helpful Content cambió el enfoque de evaluación. Ya no se trata solo de evitar spam técnico. Se trata de medir si el contenido aporta valor real al usuario.

Cuando un sitio publica contenido masivo orientado únicamente a capturar long tails sin profundidad ni experiencia demostrable, el sistema lo identifica como contenido orientado a motores de búsqueda. Y ajusta su visibilidad global.

El impacto no es aislado por URL. Puede afectar al dominio completo.

Aquí está la tensión estratégica: producir volumen sin autoridad temática sostenida activa señales de bajo valor. Y el Black Hat moderno suele esconderse detrás de producción masiva automatizada.

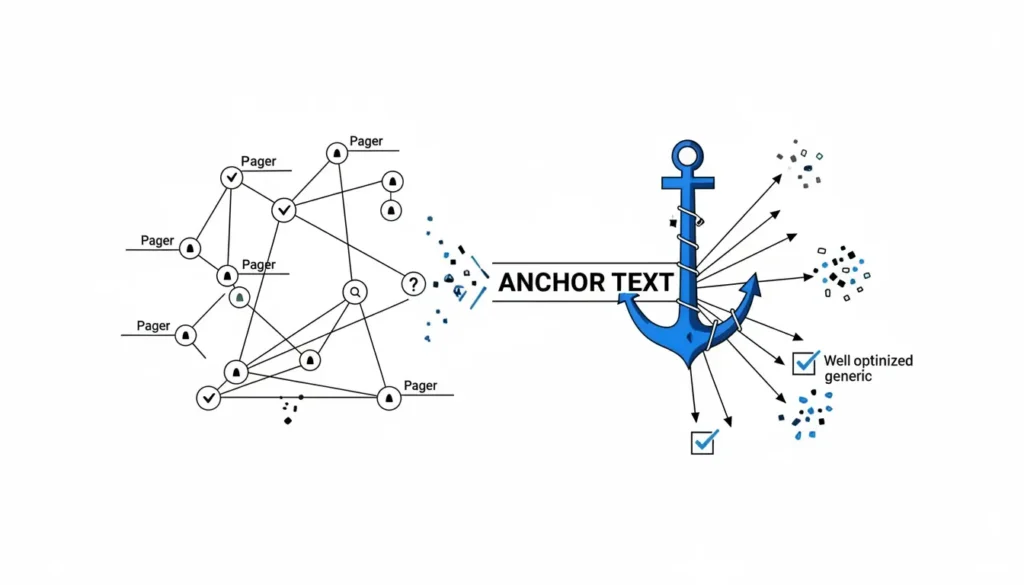

Link Spam Updates y señales de enlaces artificiales

Los enlaces siguen siendo un factor relevante. Pero el análisis ya no es binario. Google evalúa naturalidad, contexto y diversidad real.

Un perfil de enlaces con patrones repetitivos, anchors forzados o redes interconectadas artificialmente activa señales de manipulación. No importa si los dominios parecen distintos. El sistema detecta relaciones estructurales invisibles al análisis superficial.

El resultado puede ser:

- Devaluación parcial de enlaces.

- Pérdida de autoridad transmitida.

- Ajustes de ranking progresivos.

Aquí se confirma algo importante: el Black Hat SEO no suele morir por una penalización explosiva. Muere por erosión continua.

Las 10 técnicas de Black Hat SEO que debes evitar

Si has llegado hasta aquí, ya entendiste algo esencial: el Black Hat SEO no cae por casualidad. Cae porque deja patrones. Y los patrones hoy son rastreables, medibles y neutralizables.

Ahora entramos en lo concreto. No como lista superficial, sino como análisis táctico. Cada técnica la vamos a desmontar bajo la misma lógica: qué promete, cómo funciona, cómo la detecta Google y qué alternativa estratégica deberías aplicar.

1. Keyword stuffing moderno

El dolor es claro: quieres posicionar para una keyword específica y decides reforzarla en exceso. La insertas en títulos, subtítulos, primeros párrafos y bloques repetitivos con variaciones mínimas.

Hace años funcionaba. Hoy no.

El análisis actual es semántico. Google entiende contexto y relaciones entre entidades. Cuando detecta densidades artificiales o repeticiones innecesarias que no aportan claridad, ajusta relevancia. No penaliza por repetir una palabra. Penaliza por romper naturalidad y experiencia.

La alternativa estratégica es clara: trabajar profundidad temática, no repetición mecánica.

2. Cloaking

El cloaking consiste en mostrar contenido diferente al usuario y al buscador. Una versión optimizada para Google y otra para el visitante.

El problema es que el sistema actual compara múltiples renderizados, analiza comportamiento de usuario y detecta discrepancias estructurales. Si el contenido visible no coincide con lo rastreado, se activa señal de manipulación directa.

Aquí no hay zona gris. Es una práctica claramente identificable.

La alternativa no es esconder. Es optimizar sin ocultar.

3. Private Blog Networks (PBNs)

Las PBNs prometen control total sobre enlaces. Creas o compras dominios aparentemente independientes para enlazar tu proyecto principal.

El análisis algorítmico ya no depende solo de IPs compartidas. Detecta patrones de interconexión, estructuras similares, anchors repetitivos y señales históricas de propiedad.

Cuando el sistema identifica una red artificial, puede devaluar la autoridad transmitida o afectar al dominio central.

El problema no es el enlace. Es la artificialidad del ecosistema.

4. Compra masiva de enlaces

Comprar enlaces sigue existiendo porque sigue prometiendo atajos. Sin embargo, los sistemas actuales evalúan naturalidad del crecimiento, coherencia temática y contexto editorial.

Un perfil que crece abruptamente con anchors optimizados y sitios irrelevantes genera señales de manipulación. La consecuencia más común no es penalización manual. Es pérdida de efectividad de esos enlaces.

El algoritmo no necesita castigarte. Solo ignora la señal.

5. Contenido generado masivamente sin valor

Automatizar contenido para cubrir miles de long tails parece una estrategia escalable. El problema es que la escala sin profundidad activa señales de bajo valor.

Helpful Content analiza experiencia real, coherencia temática y utilidad práctica. Si el contenido existe solo para capturar impresiones, el dominio pierde confianza progresiva.

La producción masiva sin criterio estratégico ya no es crecimiento. Es exposición.

6. Doorway pages

Las doorway pages son páginas creadas exclusivamente para posicionar por una variación específica y redirigir o empujar al usuario a otra sección.

El patrón es claro: múltiples URLs con estructura casi idéntica orientadas a microvariaciones geográficas o semánticas.

El sistema detecta duplicidad estructural y falta de valor independiente. La consecuencia suele ser desindexación parcial o pérdida de relevancia.

Si una página no puede sostenerse sola, no debería existir.

7. Scraping de contenido

Copiar contenido de otros sitios con ligeras modificaciones sigue siendo una práctica utilizada en nichos competitivos.

El análisis actual no se limita a coincidencia textual. Detecta similitud estructural, fuentes originales y patrones de replicación.

El resultado no es solo pérdida de ranking. Es invisibilidad progresiva frente a la fuente original.

El algoritmo prioriza originalidad contextual, no copia superficial.

8. Redirecciones engañosas

Redirigir usuarios hacia contenidos distintos a los indexados o manipular flujos para captar tráfico específico activa señales de comportamiento anómalo.

Si el usuario entra esperando una cosa y recibe otra, el sistema detecta rebote rápido, inconsistencias y señales negativas.

La experiencia incoherente deja rastro.

9. Esquemas de enlaces automatizados

Herramientas que generan enlaces masivos en foros, comentarios o perfiles siguen circulando. El problema es que el patrón es evidente.

Anchors repetitivos, contextos irrelevantes, publicaciones simultáneas en múltiples dominios. Todo deja huella.

Google no necesita identificar cada enlace manualmente. Solo necesita reconocer el patrón agregado.

10. SEO negativo y ataques externos

El SEO negativo intenta perjudicar a competidores generando enlaces tóxicos o ataques de reputación.

Los sistemas actuales están diseñados para neutralizar gran parte de estos intentos, pero no son infalibles. Por eso el monitoreo constante del perfil de enlaces es estratégico.

La defensa aquí es vigilancia, no contraataque.

Qué ocurre cuando Google detecta prácticas Black Hat SEO

El verdadero riesgo del Black Hat SEO no es la penalización pública. Es la pérdida de confianza algorítmica. Y esa pérdida rara vez se anuncia con un mensaje dramático en Search Console. Muchas veces ocurre en silencio.

Aquí es donde muchos proyectos se equivocan. Esperan una acción manual visible para reaccionar. Sin embargo, el ajuste más común es algorítmico. Google simplemente recalibra el peso de tus señales. Lo que antes impulsaba rankings deja de tener efecto. El crecimiento se detiene. La autoridad se erosiona.

El problema no es la caída puntual. Es la incapacidad de volver a escalar.

Penalización algorítmica vs penalización manual

Una penalización manual es explícita. Recibes notificación. Sabes que existe una infracción concreta. Puedes trabajar en corregirla y solicitar reconsideración.

La penalización algorítmica es distinta. No hay aviso. Solo cambios en visibilidad. Pérdida de posiciones. Reducción de tráfico orgánico. A veces afecta secciones completas. A veces impacta el dominio global.

La mayoría de prácticas de Black Hat SEO hoy terminan en ajustes algorítmicos, no en acciones manuales. Eso las hace más difíciles de diagnosticar.

Cuando el sistema detecta patrones manipulativos, no necesita eliminarte. Puede simplemente reducir tu competitividad frente a dominios con señales más coherentes.

Pérdida de autoridad y recuperación compleja

Aquí está la parte que muchos subestiman: recuperar confianza algorítmica es lento.

Si un dominio ha utilizado esquemas de enlaces artificiales o producción masiva sin valor, el sistema registra ese historial. Aunque elimines las prácticas, la recuperación no es inmediata. La autoridad se reconstruye gradualmente, no se restaura automáticamente.

Además, el mercado no se detiene mientras corriges. Competidores continúan fortaleciendo sus activos. El costo de oportunidad se multiplica.

La validación estratégica es contundente: el Black Hat SEO no solo pone en riesgo posiciones actuales. Compromete capacidad futura de crecimiento.

En entornos competitivos, perder tracción durante meses puede significar perder mercado.

Estrategia alternativa: Cómo competir sin manipular

Si el Black Hat SEO se basa en simular relevancia, la estrategia sostenible se basa en construirla. Y construir implica tiempo, coherencia y estructura. No es menos agresivo. Es más inteligente.

El dolor aquí es claro: competir contra dominios con años de autoridad parece intimidante. Sin embargo, intentar igualarlos con manipulación solo acelera tu desgaste. La alternativa no es resignarse. Es diseñar un sistema que acumule ventaja progresiva.

La clave no está en evitar prácticas prohibidas por miedo. Está en entender cómo se genera confianza algorítmica real.

Arquitectura de contenido alineada a intención

La primera diferencia estructural es esta: en lugar de producir páginas aisladas para capturar keywords, construyes clusters temáticos coherentes.

Cada pieza responde a una intención específica. Informativa, comparativa, transaccional. No repites variaciones mínimas para capturar tráfico fragmentado. Diseñas recorridos naturales de navegación.

Cuando el usuario encuentra profundidad, el comportamiento mejora. Y el comportamiento alimenta señales positivas. Tiempo de permanencia, interacción, navegación interna. El algoritmo detecta coherencia entre promesa y entrega.

Esa coherencia es acumulativa.

Autoridad temática progresiva

Google no solo evalúa páginas individuales. Evalúa autoridad por tema. Si publicas contenido disperso sin especialización clara, diluyes fuerza.

La estrategia sostenible consiste en dominar un eje temático y expandirlo progresivamente. No abarcar todo. Profundizar en lo que realmente puedes respaldar con experiencia.

Cuando un dominio demuestra consistencia en un área específica, el sistema le otorga mayor confianza para posicionar nuevas piezas relacionadas.

La autoridad no se compra. Se demuestra.

Crecimiento natural del perfil de enlaces

En lugar de fabricar enlaces, la estrategia alternativa es crear activos enlazables: estudios, guías profundas, herramientas, análisis originales.

Los enlaces naturales no crecen de forma explosiva. Crecen de forma coherente. Y esa coherencia es más poderosa que cualquier red artificial.

Cuando el crecimiento del perfil de enlaces coincide con expansión real de contenido y visibilidad, el patrón es orgánico. Y el algoritmo lo interpreta como legítimo.

Optimización técnica sin distorsión

Velocidad, estructura semántica, experiencia móvil, datos estructurados. Todo suma. Pero suma cuando está alineado con valor real.

Optimizar no es exagerar. Es facilitar, reducir fricción, es mejorar comprensión.

Cuando técnica y contenido trabajan juntos, el dominio se vuelve sólido. Y un dominio sólido es menos vulnerable a volatilidad algorítmica.

El costo real de intentar engañar al algoritmo

El Black Hat SEO seduce porque promete velocidad. Pero la velocidad sin estructura no es ventaja competitiva. Es fragilidad.

A lo largo de este análisis has visto algo importante: las técnicas manipulativas no desaparecieron porque Google “se volvió más estricto”. Desaparecieron porque el sistema evolucionó hacia un modelo basado en patrones, coherencia y comportamiento real. Hoy no compites solo contra otros sitios. Compites contra un algoritmo que aprende.

El error estratégico no es usar una técnica puntual. El error es adoptar una mentalidad de explotación constante. Cuando tu modelo depende de vulnerabilidades temporales, tu crecimiento depende de cuánto tarden en cerrarlas. Y ese margen se reduce cada año.

El costo real no es una penalización manual. Es más profundo:

- Pérdida progresiva de autoridad.

- Incapacidad de escalar nuevas keywords.

- Volatilidad constante en rankings.

- Tiempo invertido en recuperación en lugar de expansión.

Mientras intentas reparar daño, otros consolidan activos.

La alternativa no es ser conservador. Es ser estructural. Diseñar arquitectura de contenido coherente. Construir autoridad temática. Optimizar sin distorsionar. Crecer alineado con la lógica del sistema.

Actualmente el SEO no premia al más agresivo. Premia al más consistente.

Y si estás construyendo un proyecto serio, la pregunta no es si puedes usar Black Hat SEO. La pregunta es si puedes permitirte las consecuencias.